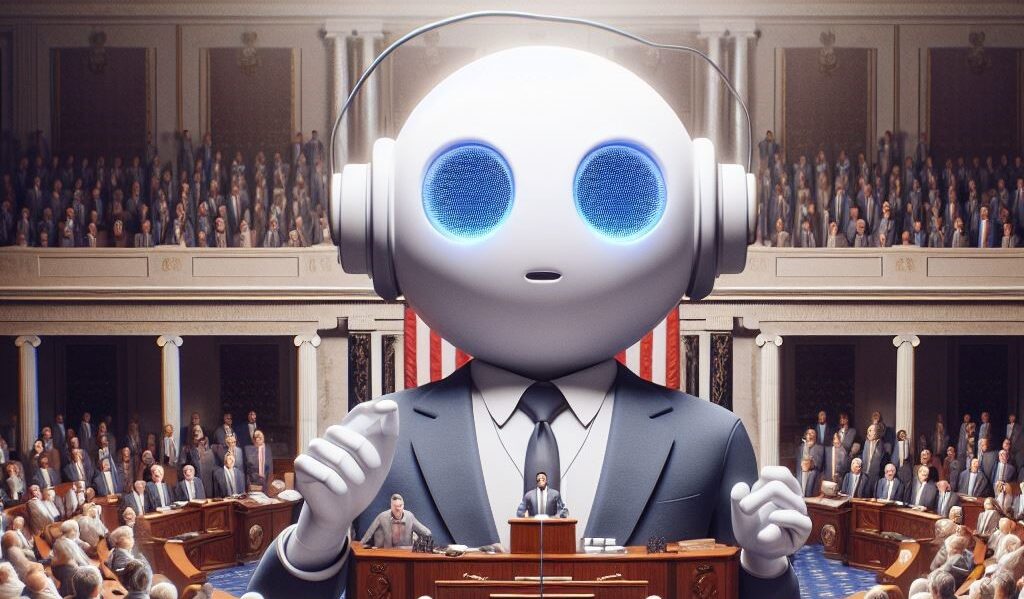

OpenAI ha anunciado la creación de un equipo dedicado a integrar ideas de gobernanza “crowdsourced” en sus modelos de inteligencia artificial. La iniciativa busca alinear los futuros modelos de IA de la compañía con los valores de la humanidad, incorporando sugerencias del público en sus productos y servicios. Este equipo, denominado Colectivo de Alineación, está compuesto por investigadores e ingenieros que trabajarán en la creación de un sistema para recoger y “codificar” las aportaciones del público.

La formación de este equipo es una extensión del programa público de OpenAI, que comenzó en mayo del año pasado con el objetivo de financiar experimentos para establecer un “proceso democrático” que determine las reglas que deben seguir los sistemas de IA. El programa financió a individuos, equipos y organizaciones para desarrollar pruebas de concepto que pudieran responder a preguntas sobre límites y gobernanza de la IA.

En una publicación de blog, OpenAI resumió el trabajo de los beneficiarios de las subvenciones, que incluyó desde interfaces de chat en vídeo hasta plataformas para auditorías crowdsourced de modelos de IA y “enfoques para mapear creencias en dimensiones que se puedan utilizar para ajustar el comportamiento del modelo”. Todo el código utilizado en el trabajo de los beneficiarios se hizo público esta mañana.

A pesar de las críticas de regulación en la UE y otros lugares, y las acusaciones de rivales como Meta de intentar asegurar la “captura regulatoria de la industria de la IA”, OpenAI ha intentado presentar el programa como independiente de sus intereses comerciales. La compañía también enfrenta un escrutinio creciente por parte de los legisladores, incluida una investigación en el Reino Unido sobre su relación con Microsoft, su socio y inversor cercano.