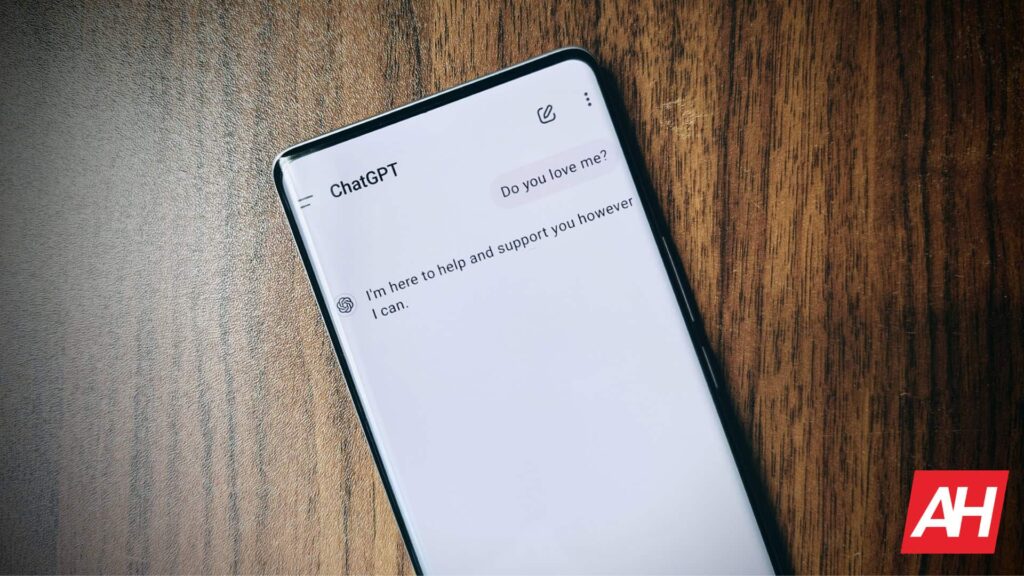

Todo el mundo sabe que un chatbot es completamente artificial y no puede sustituir a un ser humano… ¿verdad? Como AI se vuelve más convincente, nos hacemos esa pregunta cada vez más. Abierto AI Recientemente hizo una publicación en su blog donde expresó su preocupación por las personas que establecen relaciones con GPT-4o.

Este es el último y mejor modelo de IA de la compañía. OpenAI lo presentó en mayo y desde entonces lo ha lanzado tanto para usuarios pagos como no pagos. Lo hemos visto en acción durante su anuncio y está claro que la compañía tiene grandes planes para este modelo. Este nuevo modelo viene con razonamientos más poderosos y respuestas más humanistas.

A OpenAI le preocupa que las personas puedan establecer relaciones con GPT-4o

Por extraño que parezca, la amenaza de que las personas establezcan relaciones reales con la IA es algo muy real. Hemos visto esos anuncios vergonzosos de Replika y nos burlamos y nos preguntamos cómo una empresa como esa podría mantenerse a flote. Bueno, el quid de la cuestión es que logró mantenerse a flote. Existe un mercado de personas que están entablando relaciones con sus nuevos amigos imaginarios digitales.

Bueno, a las personas que fabrican el modelo de IA más avanzado les preocupa que GPT-4o pueda ser demasiado convincente.

“Durante las primeras pruebas, incluidas las pruebas de equipos rojos y de usuarios internos, observamos que los usuarios usaban un lenguaje que podría indicar que se estaban formando conexiones con el modelo. Por ejemplo, esto incluye lenguaje que expresa vínculos compartidos, como «Este es nuestro último día juntos». Si bien estos casos parecen benignos, indican la necesidad de continuar investigando cómo estos efectos podrían manifestarse durante períodos de tiempo más largos..”

En la IA confiamos

En la publicación, OpenAI esbozó algunas razones por qué formar una conexión con una IA podría ser algo malo. Para empezar, nunca conviene confiar demasiado en lo que dice una IA. Es fácil ver cuál podría ser el problema.

Cuando tomas la palabra de una IA, comienzas a olvidar que lo que dice puede no ser 100% exacto. Los modelos de IA siguen alucinando, sin importar cuántos parámetros tengan. Confiar implícitamente en un modelo de IA lo pone en riesgo de absorber y creer información falsa.

¿Quién necesita gente?

A continuación, la publicación hablaba de algo que les recordaría la tercera ley de Newton. La reacción igual y opuesta al establecer relaciones con la IA puede ser que se empiece a perder la necesidad de interacciones humanas. Tendemos a burlarnos de la persona que tiene una novia o un novio con IA. Sin embargo, esto sugiere un patrón potencialmente destructivo.

Las personas corren el riesgo de renunciar a establecer relaciones humanas. Además de eso, las personas también podrían dejar que sus relaciones existentes se deterioren.

Todavía no estamos en una época distópica

Esto no quiere decir que esto esté sucediendo (bueno, no a gran escala). La empresa simplemente expresa su preocupación de que esto se convierta en un problema. La empresa va a continuar su investigación sobre este asunto.

Fuente: Android authority