Como modelos de inteligencia artificial como ChatGPT y Géminis Cuando se hicieron más potentes, requirieron enormes cantidades de RAM para funcionar. Esto aumentó la demanda hasta el punto en que los precios de los chips de memoria alcanzaron niveles récord, creando una escasez global que afectó a todo, desde los centros de datos hasta las computadoras portátiles de consumo. Sin embargo, una nueva Google Un avance de la investigación llamado TurboQuant podría cambiarlo todo.

TurboQuant, presentado antes de la conferencia ICLR 2026, es un algoritmo de compresión especializado diseñado específicamente para modelos de lenguajes grandes (LLM). Según Google, este método puede reducir la memoria necesaria para ejecutar un modelo de IA hasta seis veces. En otras palabras, permite que una IA «recuerde» sus cálculos pasados utilizando sólo una pequeña cantidad del espacio físico del hardware que solía necesitar.

¿El fin del cuello de botella de la RAM? Dentro del avance TurboQuant de Google

La clave de TurboQuant reside en su eficiencia. En el mundo de la IA, los modelos utilizan algo llamado «caché de valores clave» para almacenar el contexto. De esta manera, no tendrán que volver a procesar una conversación completa cada vez que hagas una nueva pregunta. Este caché es un notorio consumidor de RAM.

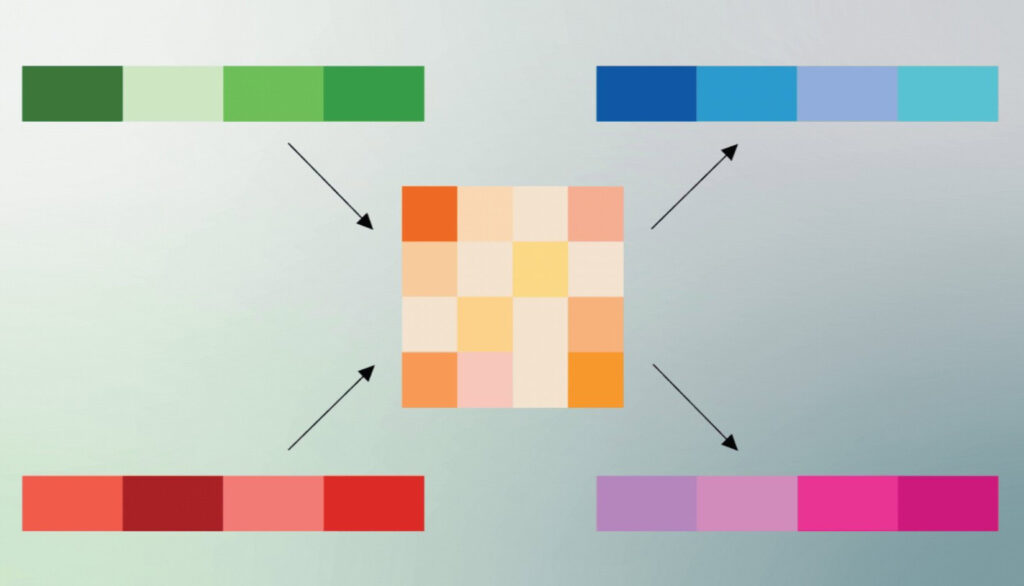

Como señaló TechCrunch, TurboQuant utiliza técnicas avanzadas de «cuantización». Esta es esencialmente una forma de simplificar los datos que utiliza la IA sin perder precisión. Es el equivalente digital de empacar una maleta de manera tan eficiente que puedes meter seis veces más ropa sin que la bolsa se vuelva más pesada. Google afirma que estos métodos operan cerca de “límites inferiores teóricos”, lo que significa que son tan eficientes como lo permite la física.

Un shock para el mercado de valores

El anuncio tuvo repercusiones en la economía mundial. Tras la noticia del avance, las acciones de los principales fabricantes de chips como Samsung, SK Hynix y Micron experimentaron caídas significativas. A los inversores les preocupaba que si los modelos de IA de repente necesitaran un 80% menos de memoria para funcionar, la demanda interminable de costosos chips de RAM finalmente podría disminuir.

Sin embargo, muchos analistas creen que la “crisis de la RAM” aún no ha terminado. Si bien TurboQuant hace que los modelos actuales sean más eficientes, también abre la puerta a proyectos de IA aún más ambiciosos. Como señalaron los expertos de SemiAnalysis a CNBC, cuando se elimina un cuello de botella, los desarrolladores generalmente responden construyendo sistemas aún más potentes que eventualmente llenan ese espacio adicional de todos modos.

¿Cuándo veremos los beneficios?

Si bien TurboQuant es un éxito de laboratorio, aún no está listo para llegar mañana a la PC de su hogar. La implementación a gran escala lleva tiempo. Además, muchas grandes corporaciones ya han asegurado muchos pedidos de memoria para el próximo año.

Sin embargo, este avance proporciona una luz muy necesaria al final del túnel. Si la IA puede volverse seis veces más eficiente solo a través del software, podríamos ver que la escasez global de RAM se aliviará mucho antes de que finalice la década.

Fuente: Android Headlines